En un mundo en el que las informaciones falsas cada vez están más presentes, los vídeos deepfakes se han convertido en un problema grave. Estas grabaciones manipuladas suponen un riesgo para las personas, pero también para la seguridad a nivel mundial.

Siempre que hay un avance tecnológico para la humanidad surgen personas dedicadas a utilizarlo para hacer el mal. La prueba la tenemos en la invención de la dinamita por Alfred Nobel en 1867. Esta creación tenía por objetivo dar más seguridad a los mineros, al ofrecerles un explosivo más seguro y fácil de controlar.

Sin embargo, no pasaría mucho tiempo hasta que esta herramienta empezase a utilizarse en actos delictivos o en guerras, lo que causaba un hondo pesar al inventor de este explosivo. Por eso, cuando Nobel falleció, creó en su testamento los premios Nobel, con los que reconocer a aquellas personas dedicadas a hacer avanzar a la sociedad. Entre ellos, se encontraba el Nobel de la Paz, dedicado a aquella persona que consiguiera una mayor contribución a la fraternidad entre países.

Pues igual que pasó con la dinamita, una revolución en su momento, algo parecido está pasando con Internet en nuestros días. Pese a tener en nuestras manos la mayor fuente de información que el hombre nunca ha conocido, hay grupos de gente con turbios intereses dedicados a difundir informaciones falsas, conocidas como fake news.

Contents

La aparición de las fake news

Aunque parezcan algo de nuestros días, lo cierto es que las primeras fake news son tan antiguas como el gran incendio de Roma, teóricamente organizado por Nerón. Posteriormente, llegarían noticias falsas sobre las riquezas del Nuevo Mundo, tras el descubrimiento de América. Y en nuestros días, las fake news están a la orden del día, convirtiéndose en herramienta básica para grupos organizados y otras entidades con poco decentes objetivos.

Igual de poco decentes son los motivos que llevan a ciertas páginas web a publicar fotos eróticas o pornográficas manipuladas de personajes famosos, principalmente actrices de Hollywood, pero también deportistas, cantantes y otras profesionales ampliamente conocidas. Este contenido es casi tan antiguo como el propio internet, y tradicionalmente ha sido de poca calidad. De hecho, la técnica más utilizada es la de usar una herramienta de edición fotográfica, “cortar” el rostro de la persona y “pegarlo” en una foto subida de tono, tratando de simular que quien aparece es la famosa de moda.

La llegada de los deepfakes

Aunque es obvio que este contenido no es ético ni legal, lo cierto es que, pasada la sorpresa inicial, basta un segundo vistazo a la imagen para comprobar que esa foto está manipulada. Sin embargo, la llegada de nuevas tecnologías, como Fake App, amenaza con agravar considerablemente este problema. Hablamos de un programa que ni siquiera requiere de un ordenador de sobremesa para funcionar, sino que puede usarse directamente desde el móvil y que permite crear vídeos falsos en unos pocos minutos.

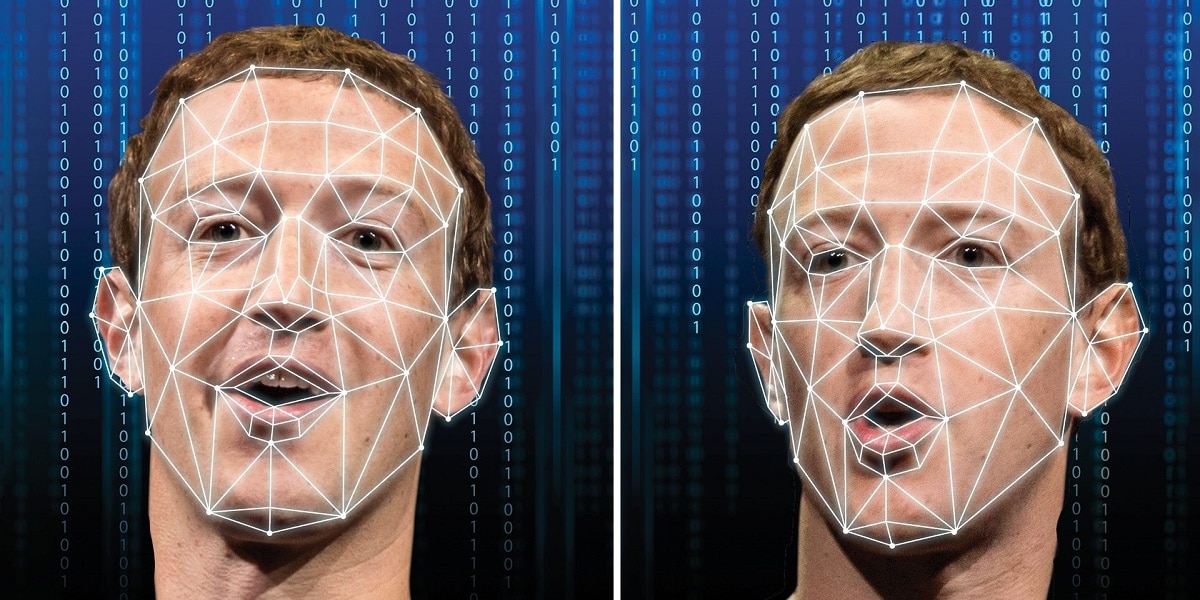

Frente al diseño estático de la imagen, estas aplicaciones permiten reemplazar el rostro de una persona por otra, empleando para ello Machine Learning. Esta tecnología procesa el vídeo fotograma a fotograma y lo encaja con las imágenes que hayamos subido del rostro de la persona. En ellas se identifican la boca, los ojos, la nariz y el resto de rasgos de la persona, por lo que el ajuste del rostro de la persona suplantada sobre el vídeo original es cada vez más eficiente.

Una vez completado el montaje, plano a plano, la aplicación se encarga de crear un vídeo con las mismas características del original, pero con el rostro de la persona objetivo. Cuanto mayor sea la cantidad de contenido de la persona a suplantar que se le aporte a la aplicación, mejor será el resultado del vídeo, que además “aprende” de sí misma para mejorar el resultado.

Por tanto, ya no hablamos de una foto editada con Photoshop, en la que la cara no pega ni con cola sobre el cuerpo, sino que hablamos de vídeos en movimiento en los que el rostro de la persona encaja e incluso se mueve como sería esperable conforme a la actividad que sucede en el vídeo.

Los riesgos de los deepfakes

Llegados a este punto, es evidente que esta tecnología supone un grave riesgo en todo tipo de ámbitos. Uno de ellos ya lo hemos comentado, en lo que respecta al carácter sexual de muchos de los vídeos falsos creados con esta tecnología. Una simple búsqueda en la red nos trae de vuelta numerosos portales pornográficos especializados en la creación de este tipo de vídeos.

Esto ha llevado a diversos países a ilegalizar este tipo de contenidos y condenar los vídeos creados mediante tecnología deepfake de contenido pornográfico o bien el llamado porno de venganza. El problema es que, en muchas ocasiones, es complicado dar con el origen del vídeo, por lo que es igual de difícil condenar a su autor.

Sin embargo, existe un riesgo aún mayor en los deepfakes, que puede afectar a la seguridad nacional de muchos países. Pensemos en un vídeo en el que el presidente de un país amenaza a otro con una invasión o que pide “eliminar a todos los negros” o “que se agreda a las mujeres”.

Gracias a las tecnologías de síntesis de voz y el sistema deepfake, es posible poner a cualquier persona a decir lo que queramos, lo que puede suponer un grave problema para los países afectados. Por tanto, el riesgo del deepfake es más que considerable. Sobre todo, ante la falta de espíritu crítico de muchas personas que reciben estos contenidos, que se tragan todo lo que ven.

Cómo detectar un deepfake

Frente a aquellas fotos mal modificadas de antaño, la tecnología de Machine Learning que se emplea en los deepfakes hace muy difícil el proceso de detectar estos contenidos. Sí es cierto que, si tienes una buena vista, es posible que mientras visualizas el vídeo percibas que la persona que habla mantiene una actitud poco natural o bien su expresión no encaja con lo que sería esperable conforme a lo que dice.

Otros elementos que nos ayudan en esta tarea es verificar la sincronización de los labios, la presencia de un tono de piel irregular o bien movimientos faciales y del cabello que no acaban de encajar en lo que sería real. Un trabajo detectivesco que muchas empresas ya están tratando de automatizar, mediante apps destinadas a verificar si un vídeo es real o no. No obstante, estas aún se encuentran en una fase temprana de su desarrollo.

Mientras tanto, la única opción que nos queda es verificar si lo que ese personaje dice está recogido en otro medio, verificar la fuente de la que procede ese vídeo y, sobre todo, no creernos nada que pueda parecer demasiado extraño para ser verdad. Algo útil en todos los aspectos de nuestra vida.

DEJA UN COMENTARIO

0 COMENTARIOS